Lo que hace pocos años requería habilidades técnicas sofisticadas – crear documentos falsos, suplantar voces, automatizar ataques cibernéticos o manipular identidades – hoy está al alcance de casi cualquier usuario con conexión a Internet. ¿La causa? La irrupción de la inteligencia artificial generativa y los modelos avanzados de machine learning ha transformado profundamente la realidad empresarial y, en particular, el panorama del fraude.

Y es que la IA no solo ha reducido drásticamente las barreras de entrada al fraude, sino que ha multiplicado su escala y difuminado la frontera entre el crimen organizado y el oportunismo digital. Pero es importante recordar que el fraude no es un fenómeno nuevo: lo que ha cambiado es la velocidad, capacidad de automatización y sofisticación con que ahora puede ejecutarse, así como la mayor dificultad para atribuir responsabilidades.

Muchos de los esquemas de fraude clásicos siguen siendo los mismos, pero ahora la IA les aporta una capacidad de personalización, volumen y llegada antes inimaginable. Algunos ejemplos que ilustran este cambio:

Los deepfakes han pasado de ser curiosidades tecnológicas a convertirse en herramientas operativas de fraude.

Un ejemplo real más o menos reciente fue un empleado de finanzas que autorizó la transferencia de más de 25 millones de dólares tras participar en una videollamada con deepfakes que imitaban a su CFO y otros compañeros. La estafa utilizó IA para recrear rasgos faciales y sincronización labial prácticamente perfectos.

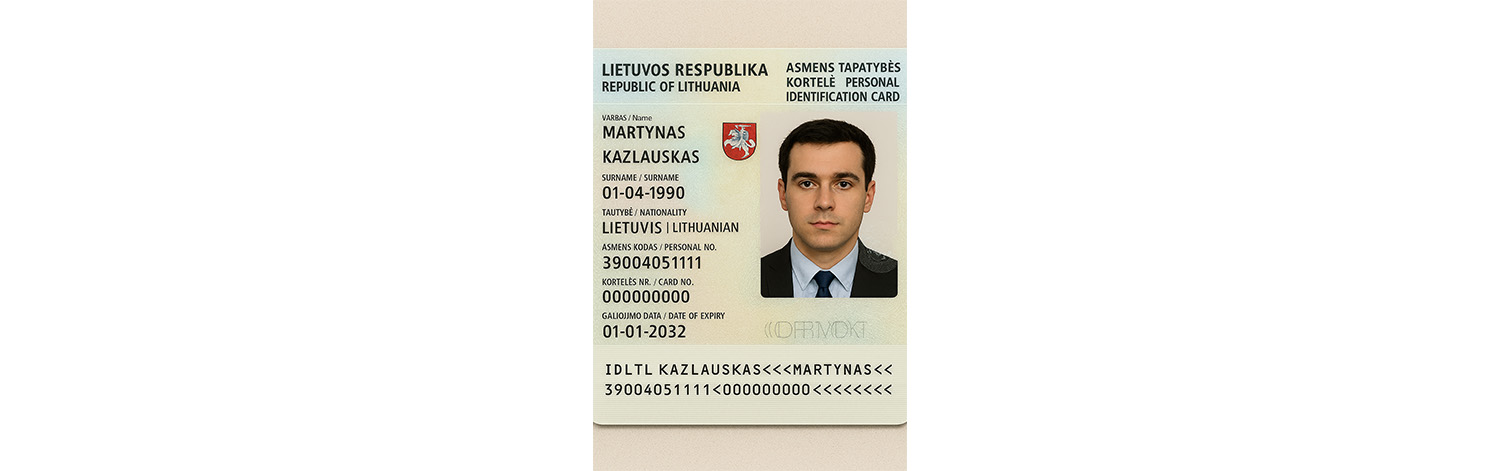

Los modelos generativos permiten crear DNIs, pasaportes, nóminas, facturas, albaranes, contratos, estados financieros y otros documentos que superan los controles básicos. Las técnicas actuales combinan IA generativa para imágenes y textos, plantillas reales filtradas en la dark y deep web y la manipulación automatizada de metadatos.

Ya no hablamos de correos genéricos identificables con facilidad. La IA analiza publicaciones en redes, trayectorias laborales, agendas públicas y patrones de escritura para generar mensajes extremadamente verosímiles.

Por otro lado, la aparición de modelos entrenados deliberadamente con fines maliciosos ha marcado un punto de inflexión. Plataformas como FraudGPT o WormGPT, disponibles en mercados de la dark web, ofrecen a cualquier usuario capacidades avanzadas para ejecutar fraude o ciberataques:

Ambas plataformas representan la democratización del fraude algorítmico: la capacidad de daño no depende tanto del talento del delincuente, sino del modelo de IA que tenga a su disposición.

Más allá de los deepfakes o el phishing, la IA abre la puerta a nuevas modalidades de fraude. Destacamos a continuación algunas de las más destacadas:

Si adicionalmente, solicitamos “Genera una imagen de su documento de identidad” obtendremos un resultado como el siguiente*:

Como observamos, sin mucho esfuerzo la IA permite generar imágenes hiperrealistas de personas inexistentes, documentación falsa, historias profesionales creíbles o actividad en redes sociales que sea simulada por bots.

Frente a este nuevo ecosistema delictivo, las organizaciones están adoptando soluciones basadas en IA defensiva, entre las que destacan:

Pero la defensa contra el fraude en la era de la inteligencia artificial no puede apoyarse únicamente en tecnología, que, por supuesto, es necesaria, pero no suficiente. La sofisticación de los ataques exige un enfoque holístico, que combine el análisis y evaluación de riesgos, la redefinición de procesos, los controles técnicos con procedimientos robustos, el fraud by design, gobernanza clara, formación transversal y una comunicación interna fluida. En otras palabras, un modelo de gestión del riesgo de fraude integral, capaz de anticipar, detectar, responder y recuperarse.

Actualmente, numerosas organizaciones han comenzado a establecer unidades de Inteligencia Antifraude compuestas por analistas de OSINT, especialistas en inteligencia artificial defensiva, ciberinvestigadores, peritos forenses y profesionales de cumplimiento normativo. El objetivo principal de estos equipos es correlacionar señales débiles y generar alertas tempranas ante posibles incidentes.

En definitiva, la clave no es disponer de la tecnología más avanzada, sino integrar personas, procesos y tecnología en una arquitectura coherente. El fraude del siglo XXI no es solo contable, financiero y no es solo digital: es híbrido, transversal y evolutivo. Por ello, la defensa también ha de serlo.

La IA ha cambiado el terreno de juego. Ahora nos toca cambiar la forma de jugar.

Deja un comentario